Принятие решений

В сформулированных выше условиях задача классификации сводится к задаче статистической проверки двух гипотез H1 и H2,

![]() ,

,

![]() .

.

В процессе принятия решения возможны ошибки 1-го и 2-го родов. Вероятность ошибки 1-го рода – вероятность отклонить гипотезу Н1 в то

время, когда она истинна. Вероятность ошибки 2-го рода – вероятность принять гипотезу Н2 в то время, когда истинной является гипотеза Н1. Эти два вида ошибок часто неодинаково важны для лица, принимающего решение. Поэтому вводятся цены ошибок 1-го и 2-го рода. Пример из гидролокации: пусть w1 – множество сигналов, создаваемых подводной лодкой, w2 – множество других морских сигналов, не создаваемых подводной лодкой. Ошибка 1-го рода – пропустить сигнал подводной лодки (пропуск цели), ошибка 2-го рода – принять морской шум за сигнал подводной лодки (ложная тревога). В этом случае ошибка 1-го рода имеет бóльший вес, чем ошибка 2-го рода.

Пусть c1 – цена ошибки 1-го рода, c2 – цена ошибки 2-го рода, p1 – априорная вероятность класса w1, p2 – априорная вероятность класса w2, p1+p2=1 (p1 – вероятность того, что любое наблюдение ХÎw1 без учета функции распределения F1(X)). Проекция линии пересечения поверхностей f1(x) и f2(x) на плоскость R делит ее на две полуплоскости R1 и R2,

R=R1![]() R2, R1

R2, R1![]() R2=

R2=![]() .

.

Тогда, если наблюдаемый вектор XÎR1, то X будет отнесен к классу w1, а если X![]() , то X будет отнесен к классу w2. Вычислим вероятность правильной и неправильной классификаций вектора X. Если XÎw1, то вероятность его правильной классификации равна

, то X будет отнесен к классу w2. Вычислим вероятность правильной и неправильной классификаций вектора X. Если XÎw1, то вероятность его правильной классификации равна

![]() ,

,

а вероятность его неправильной классификации равна

![]() . (2.20)

. (2.20)

Аналогично, если XÎw2, то вероятности его правильной и неправильной классификации равны соответственно

![]() ,

,

![]() . (2.21)

. (2.21)

Вероятность ошибки 1-го рода задается формулой (2.20), вероятность ошибки 2-го рода – формулой (2.21). В соответствии с теорией статистических решений целесообразно ввести решающее правило классификации, минимизирующее риск

![]() .

.

Используя выражения (2.20), (2.21), имеем

![]() . (2.22)

. (2.22)

Так как

![]() , R2 = R \ R1,

, R2 = R \ R1,

то первый интеграл в выражении (2.22) представим в виде

![]() . (2.23)

. (2.23)

На основании равенства (2.23) выражение (2.22) преобразуется к виду

![]() .

.

Так как ![]() , то необходимым условием минимума функции y является отрицательность подынтегральной функции,

, то необходимым условием минимума функции y является отрицательность подынтегральной функции,

![]() .

.

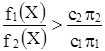

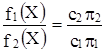

Из последнего выражения имеем

![]() ,

,

или

. (2.24a)

. (2.24a)

Правая часть в (2.24а) – коэффициент подобия

,

,

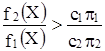

который является постоянным для данного выбора с1, с2. Если ![]() , то Т=1. Если имеет место неравенство (2.24а), то наблюдаемый вектор Х относится к классу w1. Если выполняется неравенство

, то Т=1. Если имеет место неравенство (2.24а), то наблюдаемый вектор Х относится к классу w1. Если выполняется неравенство

, (2.24б)

, (2.24б)

то наблюдаемый вектор Х относится к классу w2. Если выполняется равенство

, (2.24в)

, (2.24в)

то наблюдаемый вектор Х относится к одному из классов w1, w2. Уравнение (2.24в) – уравнение границы классов w1, w2. Сформулированное решающее правило относится к так называемым правилам Байеса.

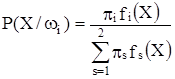

Провести классификацию наблюдаемого вектора Х можно и по другому правилу, по максимуму его апостериорной вероятности. При условиях нашей задачи можно вычислить апостериорную вероятность ![]() , принадлежности вектора Х к классу wi:

, принадлежности вектора Х к классу wi:

.

.

Тогда вектор Х относится к тому классу ![]() , для которого значение апостериорной вероятности максимально. (2.7). Это правило не учитывает цен ошибок 1-го и 2-го родов

, для которого значение апостериорной вероятности максимально. (2.7). Это правило не учитывает цен ошибок 1-го и 2-го родов ![]() .

.

К описанной здесь методике удается свести многие практические задачи, формулируя их в терминах статической теории решений. Полезность этой теории и ее методов ограничивается допущением, что плотности вероятностей ![]() известны. В некоторых случаях это действительно имеет место.

известны. В некоторых случаях это действительно имеет место.

Если функции ![]() неизвестны, то получают их оценки

неизвестны, то получают их оценки ![]() по обучающим выборкам аппроксимационными методами. Распознание базируется на сопоставлении уже полученных оценок

по обучающим выборкам аппроксимационными методами. Распознание базируется на сопоставлении уже полученных оценок ![]() для исследуемого объекта Х пространства R по правилам [2.24].

для исследуемого объекта Х пространства R по правилам [2.24].

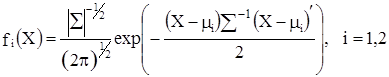

Байесовское решающее правило принимает простой вид в случае, когда ![]() – плотности вероятностей нормальных распределений с равными ковариационными матрицами å и различными векторами средних значений mi:

– плотности вероятностей нормальных распределений с равными ковариационными матрицами å и различными векторами средних значений mi:

.

.

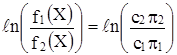

В этом случае уравнением границы (2.24в) является линейная функция. Прологарифмировав равенство (2.24в),

, (2.25)

, (2.25)

и проведя в его левой части умножения матриц, после приведения подобных членов с учетом (2.25) получим линейное уравнение

![]() .

.

Первое слагаемое в левой части последнего равенства называется линейной дискриминантной функции Фишера,

![]() .

.

Неравенство (2.24а) в этом случае принимает вид

![]()

Область наилучшей классификации определяется так:

![]() , (2.26а)

, (2.26а)